Séminaire : La complexité dans les sciences

Nous vivons dans une illusion : celle que le monde peut être contrôlé., que si nous avons assez de données, d’algorithmes, de modèles, nous pourrons tout prévoir. Mais le réel n’obéit pas à ces croyances, il est vivant, mouvant, imprévisible.

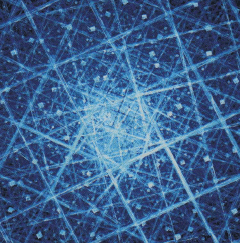

Nous évoluons dans un monde où tout est connecté : les économies, les technologies, les écosystèmes, les opinions, les émotions collectives. Les phénomènes s’enchaînent, s’amplifient, se répondent. Pourtant, nos manières de penser, de gouverner, de décider demeurent souvent linéaires : nous cherchons des causes simples, des solutions claires, des modèles prédictifs. Nous aimons croire que tout est prévisible, mesurable, maîtrisable.

La complexité échappe à cette logique. Elle se manifeste partout : dans les crises financières, les pandémies, le changement climatique, mais aussi dans les réseaux d’innovation, les dynamiques sociales ou les écosystèmes naturels. Chaque action y produit des effets imprévus ; chaque tentative de maîtrise révèle des zones d’ombre.

Nous vivons encore sous le mythe du contrôle — cette idée qu’avec suffisamment de données, d’algorithmes ou de planification, nous pourrions anticiper et maîtriser le réel. Mais la complexité ne se laisse pas dompter. Elle exige une autre posture : observer plutôt que dominer, écouter plutôt que simplifier, relier plutôt que découper.

Dans un système complexe, chaque action provoque une réaction imprévisible, chaque innovation crée de nouvelles dépendances, chaque crise révèle des fragilités cachées.

Comprendre la complexité, c’est apprendre à agir sans tout contrôler. À anticiper sans prétendre prévoir. À coopérer plutôt qu’à dominer.

Le problème n’est pas la complexité. Le problème, c’est notre obsession du contrôle.

Accepter la complexité, ce n’est pas renoncer à agir — c’est changer de posture : observer, écouter, relier, expérimenter. C’est comprendre que dans un monde complexe, la sagesse ne vient pas de la maîtrise, mais de l’adaptation.

Naviguer dans la complexité, ce n’est donc pas chercher à la réduire, mais à s’y accorder. C’est admettre que la clarté ne vient plus de la simplification, mais de la compréhension des interconnexions.

Le mot complexité est utilisé dans des contextes très variés pour rendre compte de situations se présentant dans des champs disciplinaires très différents. On peut dire de façon générale qu’il est avancé pour avouer nos capacités cognitives limitées ; la façon dont cette limitation cognitive est appréhendée se révèle spécifique de chaque domaine situationnel de connaissance en termes de démarches et d’outils.

Dans cette conférence, nous verrons comment les sciences de la complexité offrent une nouvelle boussole pour naviguer dans l’incertitude. Non pas pour simplifier le monde, mais pour apprendre à y évoluer avec lucidité, agilité et humilité.

Cette conférence explore comment les sciences de la complexité peuvent inspirer de nouvelles façons de décider, d’innover et de coopérer, elle est une invitation à sortir du fantasme du contrôle, et à réapprendre l’art de naviguer dans l’incertain.

La variété des champs de connaissance couverts par les intervenants (mathématiques, économie, biologie, informatique) vise précisément à montrer la présence, cachée ou non, de la complexité dans les environnements personnels et professionnels dans lesquels nous sommes immergés.

COORDINATION SCIENTIFIQUE

|

|

|

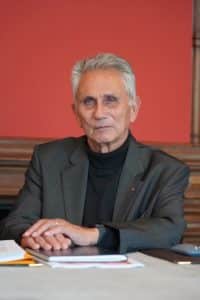

Jean-Pierre Briffaut

|

Bernard Monnier MIM |

DATE & LIEU

11 décembre 2025

08h30 - 18h00

Ecole Polytechnique

Amphithéâtre Becquerel

Route de Saclay

91128 PALAISEAU Cedex

SITUATION

PROGRAMME

08h30 – 08h55

Accueil & café

08h55 – 09h00

Introduction

Jean-Pierre BRIFFAUT

Bernard MONNIER

…

MIM

09h00 – 10h15

Le jeu du hasard et de la complexité

Philippe KOURILSKY

Membre de l’Académie des Sciences

Professeur honoraire Collège de France

10h15 – 10h30

Pause café

10h30 – 11h45

Mesurer la complexité avec la théorie du calcul : Andrei Kolmogorov et Charles Bennett.

Les exemples des blockchains et de l’IA générative

Jean-Paul DELAHAYE

Université de Lille,

Cristal UMR CNRS 9189

11h45 – 13h00

Complexité combinatoire et nombres inaccessibles

Jacques PRINTZ

Professeur émérite d’informatique CNAM

Laboratoire ETHICS Université de Lille

13h00 – 14h30

Déjeuner

14h30 – 15h45

Complexité en économie

Jean Hervé LORENZI

Professeur d’Économie honoraire

Fondateur du cercle des économistes

Président des Rencontres Économiques d’Aix-en-Provence

15h45 – 16h00

Pause café

16h00 – 17h45

XTRACTIS®, l’IA Raisonnante Générale pour des Décisions Critiques de Confiance

Prof. Zyed ZALILA

Professeur de Mathématiques du Flou & d’Intelligence Artificielle Raisonnante

Inventeur Concepteur Auteur Développeur XTRACTIS®

17h45 – 17h55

Résumé de la présentation

Matin – Partie 1

Après-midi – Partie 2

Le jeu du hasard et de la complexité | Philippe KOURILSKY

Les systèmes biologiques sont hyper complexes. L’un des mieux connus est le système immunitaire de l’homme. Sa compréhension peut faciliter celle d’autres systèmes complexes. La robustesse qu’il procure à l’organisme lui fournit une assurance vie contre les hasards de la vie. Le lien entre complexité et gestion du hasard est ici central. Il peut inspirer des hypothèses de travail dans d’autres secteurs, comme les écosystèmes, et même les systèmes sociaux. Enfin, la gestion par l’homme des systèmes complexes exige une éthique assez forte pour en éviter les dérives.

Mesurer la complexité avec la théorie du calcul | Jean-Paul Delahaye

Jean-Paul Delahaye est Professeur émérite à l’Université de Lille et chercheur au laboratoire CRISTAL (Centre de recherche en informatique signal et automatique de Lille, UMR CNRS 9189).

Ses travaux portent sur les algorithmes de transformation de suites (Thèse d’État), sur l’utilisation de la logique en Intelligence artificielle (systèmes experts, langage Prolog) sur la théorie computationnelle des jeux (jeux itérés, simulations de systèmes sociaux, étude de la coopération), et sur la théorie algorithmique de l’information (théorie de la complexité de Kolmogorov, notions de contenu en calcul) avec en particulier des applications à la bioinformatique et à l’étude des marchés financiers. Il travaille aujourd’hui plus particulièrement sur le thème des monnaies cryptographiques et sur la technologie des chaînes de blocs (« blockchain »), les stablecoins et les monnaies numériques de banques centrales. Il est membre du Comité Scientifique de l’Institut des Crypto-actifs de Paris. Il s’intéresse aux problèmes d’éthique dans les sciences et a été membre du Comité d’Éthique de CNRS (COMETS) de 2016 à 2021. Il a encadré vingt thèses. Il est l’auteur d’une vingtaine de livres, dont une partie est destinée à un large public. En 1998, il a reçu le Prix d’Alembert de la Société Mathématique de France et, en 1999, le Prix Auteur de la Culture scientifique du Ministère de l’Education Nationale et de la Recherche. Depuis plus de trente ans, il rédige la rubrique mensuelle Logique et calcul de la revue Pour la science (version française du Scientific American).

Complexité combinatoire et nombres inaccessibles | Jacques Printz

Les nombres inaccessibles ont été introduits par le mathématicien Émile Borel à l’occasion de ses travaux sur le hasard et le calcul des probabilités, d’où son principe dit des probabilités négligeables. Ces nombres apparaissent pour la première fois en physique statistique, en particulier chez Boltzmann qui les qualifie de « nombres qui défient l’imagination ». Pour en faire prendre conscience, Borel va imaginer une métaphore dite « des singes dactylographes » visant à calculer la probabilité de produire une œuvre littéraire en appuyant au hasard – c’est le rôle des singes ! – sur les touches d’une machine à écrire.

De tels nombres apparaissent très naturellement dans les sciences de l’information, en particulier en programmation. Il est nécessaire de les éviter, ne serait-ce que pour garder le contrôle des coûts de validation des systèmes, pour en garantir la qualité vis-à-vis des usagers. C’est le rôle de l’ingénierie des systèmes que de s’en assurer.

Pour cette conférence, je me suis appuyé sur mes deux livres Architecture système et complexité, 2019, et Organisation et pédagogie de la complexité, 2020, tous deux chez ISTE-Wiley, qui complète un travail un peu plus ancien, Architecture logicielle, chez Dunod, 2012.

Jacques Printz est professeur émérite du Cnam où il a été élu titulaire de la Chaire de Génie Logiciel en 1994, jusqu’en 2009. Président du département Sciences et Technologies de l’Information et de la Communication en 2000-2004 et co-directeur de l’école d’ingénieur du Cnam. Au Cnam, il a fondé le Centre de Maîtrise des Systèmes et du Logiciel [CMSL] pour promouvoir l’étude des architectures de systèmes et le management de la complexité dans les entreprises.

Ses domaines de recherche sont : architecture logicielle, techniques de tests et testabilité des systèmes, sûreté de fonctionnement, management de projets complexes, modèles d’estimation des coûts/délais des projets, mesure de la complexité, qualité, systémique appliquée à l’ingénierie des systèmes complexes.

Il a occupé plusieurs postes de responsabilité dans l’industrie du logiciel [France, États-unis, Japon] dans le domaine des systèmes d’exploitation, des compilateurs de langages de programmation, des systèmes de gestion des bases de données. Ses contributions les plus significatives ont été dans le domaines des compilateurs pour différents langages (FORTRAN, PL1, Pascal, C, Ada …) sur différentes machines.

Il a également été impliqué comme consultant dans le domaine des systèmes C4ISTAR pour la défense et la sécurité durant plus de vingt ans, nationalement et internationalement [Projets OTAN PCIS, GIADIS … et visiteur au SEI à l’université Carnegie Mellon, etc.] ; il est ingénieur en chef de l’armement honoraire.

Il est auteur ou co-auteur de nombreux livres dans le domaine du génie logiciel et de l’architecture des systèmes complexes :

Le génie logiciel, PUF, traduit en Chinois ; Puissance et limites des systèmes informatisés, Hermès, Coûts et durée des projets informatiques, Hermès ; Productivité des programmeurs, Hermès ; Écosystèmes des projets informatiques, Hermès ; Architecture logicielle, concevoir des applications simples, sûres et adaptables, Dunod, nominé pour le prix Roberval en 2008, 3ème édition ; Pratique des tests logiciels, Dunod ; Estimation des projets de l’entreprise numérique, Hermès.

Dans le cadre d’un projet de coopération qu’il a monté en Chine pour le Cnam, il a été amené à enseigner dans des universités chinoises des programmes stratégiques 211 et 985 comme Beijing University of Technology, Wuhan University (WUDA), South China University of Technology (Guangzhou/Canton), etc.

XTRACTIS®, l’IA Raisonnante Générale pour des Décisions Critiques de Confiance | Prof. Dr. Zyed ZALILA

Ces deux approches originelles ont toutefois montré leurs limites :

- Les systèmes-experts prennent des décisions en déployant des raisonnements déductifs, sur des connaissances produites par des experts (modèle transparent). Cependant, ils sont très limités dans leurs performances à cause de la logique binaire utilisée et de la faible robustesse des connaissances humaines, due à la limitation de notre entendement.

- les réseaux de neurones prennent des décisions probabilistes, par calcul tensoriel, sans faire appel à des connaissances validées et sans pouvoir justifier leurs décisions (modèle opaque). Toutefois, grâce à leur forte non-linéarité et à la vitesse de calculs proposée par les cartes GPU, ils réussissent à résoudre des classes de problèmes très intéressantes et attractives pour le grand public : perception visuelle et sonore, traduction automatique, IA générative dont les agents conversationnels.

À partir de la théorie des relations floues d’ordre N [Zalila 1993], j’ai proposé en 2003 une troisième approche : l’IA Cognitive Floue Augmentée (IACFA).

Quelles en sont ses spécificités ? L’IACFA allie la forte non-linéarité des logiques continues (dites « floues » ou à infinité d’états), l’intelligibilité des règles décisionnelles, et la robustesse de l’induction floue automatique, c’est-à-dire, la découverte automatique de connaissances à partir d’observations. L’IACFA procède ainsi selon la méthode scientifique expérimentale, introduite par al-Hassan ibn al- Hassan ibn al-Haytham al-Basri, au début du 11e siècle.

Comment exploiter l’IACFA de manière pratique ? L’IA Raisonnante Générale XTRACTIS® étend les trois formes de raisonnement humain (induction, déduction et abduction) dans une plateforme no-code.

À partir d’un ensemble de données structurées, qu’elles soient quantitatives ou qualitatives, sur le Processus/Phénomène Complexe (PPC) étudié, les robots REVEAL sélectionnent les prédicteurs pertinents et créent automatiquement les connaissances qui modélisent ce PPC, sous la forme de règles SI…ALORS à logiques continues ; puis, ils évaluent la robustesse du modèle, grâce à un processus intensif de validation croisée multicycles.

L’approche holistique décrémentale floue que je propose prend à contrepied le réductionnisme physicaliste et le causalisme incrémental binaire de Descartes : pour détecter et exploiter les signaux faibles et moyens, chaque robot induit, en première intention, un modèle avec l’intégralité des variables à sa disposition, en élaguant progressivement celles sans aucune contribution. Les robots REVEAL jouent ainsi le rôle de super-scientifiques virtuels ou d’exocerveau, permettant à n’importe expert métier de devenir un super modélisateur.

REVEAL est capable d’analyser en simultané des dizaines/centaines de milliers de variables en interactions si nécessaire, ce qu’aucun humain n’est en mesure de faire, même le plus doué d’entre nous (max 10 variables !). Formant une IA collective, évolutionniste, corrective et adaptative, les robots REVEAL vont perfectionner à l’infini 24/7/365 leurs stratégies de raisonnement inductif pour espérer découvrir des modèles encore plus robustes et plus intelligibles, en débusquant les erreurs et les biais dans les données, tout en s’adaptant à un changement de comportement du PPC. Afin de démultiplier la vitesse d’induction et de réduire la durée de découverte des top-modèles, les robots peuvent être distribués sur plusieurs serveurs physiques (scale out).

Les performances prédictive et réelle des modèles XTRACTIS® sont au moins équivalentes à celles des modèles produits par les meilleures techniques IA actuelles (forêt aléatoire, arbre boosté, réseau de neurones). Le top-modèle prédictif performant et transparent induit par XTRACTIS® peut alors être audité par l’expert métier et certifié par le régulateur, avant son déploiement : pour prédire de manière rationnelle et déterministe à très haute fréquence (PREDICT), ou rechercher les solutions les plus optimales satisfaisant des requêtes multi-objectif sous contraintes flexibles (OPTIMIZE).

Dans le cadre de cette intervention, nous exposerons comment XTRACTIS® révolutionne la recherche scientifique en accélérant la découverte de connaissances robustes. Nous expliquerons aussi pourquoi en autorisant le respect de la performance et de l’intelligibilité, l’IACFA permet la conception rapide de systèmes décisionnels critiques à haut risque (Santé, Défense, Cyber, Sécurité, Finance, Engins Autonomes, Industrie, Transports, Énergie, Environnement, Droit, RH, Gouvernance éthique et responsable) conformes à la loi européenne AI Act, dont XTRACTIS® définit l’état de l’art.

Nous insisterons sur l’importance de la souveraineté de l’IACFA garantissant des avantages stratégiques, tant économiques que géopolitiques. Nous exposerons les modèles économiques que nous avons introduits dès 2003 pour pouvoir rentabiliser l’usage des IA : les licences logicielles IA à durée temporaire et la vente du temps robots dans le cadre de prestations de service réalisées grâce à l’IA. Enfin, nous insisterons sur la nécessité de l’usage d’IA frugales ne faisant appel à aucune GPU, telles XTRACTIS®, pour limiter les consommations énergétiques et les émissions de carbone, et surtout pour éviter d’importantes consommations d’eau douce qui seraient fatales pour l’humanité.

Prof. Dr. Zyed ZALILA est PDG-Fondateur de la DeepTech IDAGRAI LABS / INTELLITECH [intelligent technologies] et son directeur R&D. Ingénieur en mathématiques appliquées et en intelligence artificielle de l’Université de Technologie de Compiègne (UTC), MSc en contrôle des systèmes, Docteur en mathématiques pures, Habilité à Diriger des Recherches, Prof. ZALILA est responsable à l’UTC, depuis 1993, de l’enseignement des mathématiques du flou et de leurs applications.

Il est l’auteur de la théorie des Relations Floues d’ordre N (1993), socle mathématique de l’IA Cognitive Floue Augmentée qu’il propose dès 2002 : cette IA découvre automatiquement des systèmes décisionnels non-linéaires performants et transparents, composés de règles SI…ALORS à logiques continues, à partir des données imparfaites du monde réel.

Il est l’inventeur de plusieurs systèmes de conduite automatique de véhicules (dès 1990), opérationnels sur route ouverte, et l’inventeur concepteur auteur développeur de l’IA Raisonnante Générale XTRACTIS® pour des décisions de confiance, dédiée à la Modélisation Prédictive Robuste, Intelligible et Auditable de processus complexes à haut risque (v1 en 2003, v14 en 2025, TRL9).